如何下载整个网站用来离线浏览?怎样将一个网站上的所有MP3文件保存到本地的一个目录中?怎么才能将需要登陆的网页后面的文件下载下来?怎样构建一个迷你版的Google? Wget是一个自由的工具,可在包括Mac,Window和Linux在内的多个平台上使用,它可帮助你实现所有上述任务,而且还有更多的功能。与大多数下载管理器不同的是,wget可跟着网页上的HTTP链接,递归地下载相关的文件。有个士兵就用过这个工具来从美军内网上下载数千个机密文件,并发布到了维基解密上。 wget下载得到整个网站的镜像 用wget下载得到整个网站的镜像

使用Wget扒行网站—-20个实用例子 1) 从网上下载单个文件

wget http://example.com/file.iso

wget --output-document=filename.html example.com

wget --directory-prefix=folder/subfolder example.com

wget --continue example.com/big.file.iso

wget --continue --timestamping wordpress.org/latest.zip

wget --input list-of-file-urls.txt

wget http://example.com/images/{1..20}.jpg

wget -page-requisites --span-hosts --convert-links --adjust-extension http://example.com/dir/file

wget --execute robots=off --recursive --no-parent --continue --no-clobber http://example.com/

wget --level=1 --recursive --no-parent --accept mp3,MP3 http://example.com/mp3/

wget --directory-prefix=files/pictures --no-directories --recursive --no-clobber --accept jpg,gif,png,jpeg http://example.com/images/

wget --mirror --domains=abc.com,files.abc.com,docs.abc.com --accept=pdf http://abc.com/

wget --recursive --no-clobber --no-parent --exclude-directories /forums,/support http://example.com 14) 下载网站上的文件,假设此网站检查User Agent和HTTP参照位址(referer)

wget --referer=/5.0 --user-agent="Firefox/4.0.1" http://nytimes.com

wget --http-user=labnol --http-password=hello123 http://example.com/secret/file.zip

wget --cookies=on --save-cookies cookies.txt --keep-session-cookies --post-data 'user=labnol&password=123' http://example.com/login.php

wget --spider --server-response http://example.com/file.iso

wget --output-document=- --quiet google.com/humans.txt 19) 得到网页的最后修改日期 (检查HTTP头中的Last Modified标签)

wget --server-response --spider http://www.labnol.org/

wget --output-file=logfile.txt --recursive --spider http://example.com wget —- 如何对服务器友好一些? wget工具本质上是一个抓取网页的网络爬虫,但有些网站主机通过robots.txt文件来屏幕这些网络爬虫。另外,对于使用了rel-nofollow属性的网页,wget也不会扒取它的链接。 不过,你可以强迫wget忽略robots.txt'和nofollow指令,只需在所有wget命令行中加上–execute robots=off选项即可。如果一个网页主机通过查看User Agent字段来屏幕wget请求,你也总是可以用–user-agent=Mozilla`选项来伪装成火狐浏览器。 wget命令会增加网站服务器的负担,因为它不断地追踪链接,并下载文件。因而,一个好的网页抓取工具应该限制下载速度,而且还要在连接的抓取请求之间设置一个停顿,以缓解服务器的负担。

wget --limit-rate=20k --wait=60 --random-wait --mirror example.com 最后是一个小测试,你认为下列wget命令是干什么用的? wget --span-hosts --level=inf --recursive dmoz.org (责任编辑:最模板) |

数据挖掘:你应该了解的所有wget命令

时间:2016-11-24 03:27来源:未知 作者:最模板 点击:次

如何下载整个网站用来离线浏览?怎样将一个网站上的所有MP3文件保存到本地的一个目录中?怎么才能将需要登陆的网页后面的文件下载下来?怎样构建一个迷你版的Google? Wget是一个

顶一下

(0)

0%

踩一下

(0)

0%

------分隔线----------------------------

- 热点内容

-

- 解决微信浏览器里location.reload问题

微信浏览器里location.reload问题会导致有时候post数据丢失。建议不...

- WEB数据挖掘相关术语整理

WEB数据挖掘建立在对大量的网络数据进行分析的基础上,采用相...

- html/asp/php页面跳转代码收集

最模板特整理了html/asp/php页面跳转的相关代码,让客户参考。...

- 如何卸载WDCP上的云锁

云锁是安全厂商椒图科技发布的一款安全管理软件,目前我司...

- htaccess重写规则排除某些目录不生效

我们用htaccess定义整站可能是针对所有目录的,比如在ecshop当中...

- 解决微信浏览器里location.reload问题

- 随机模板

-

-

ecshop仿唯伊网模板|化妆品

人气:1710

ecshop仿唯伊网模板|化妆品

人气:1710

-

PrestaShop外贸牛奶蛋糕甜点

人气:264

PrestaShop外贸牛奶蛋糕甜点

人气:264

-

ecshop仿京东2012最新模板

人气:4646

ecshop仿京东2012最新模板

人气:4646

-

ecshop仿凡客2011最新版|精品

人气:801

ecshop仿凡客2011最新版|精品

人气:801

-

shopex玛索模板

人气:358

shopex玛索模板

人气:358

-

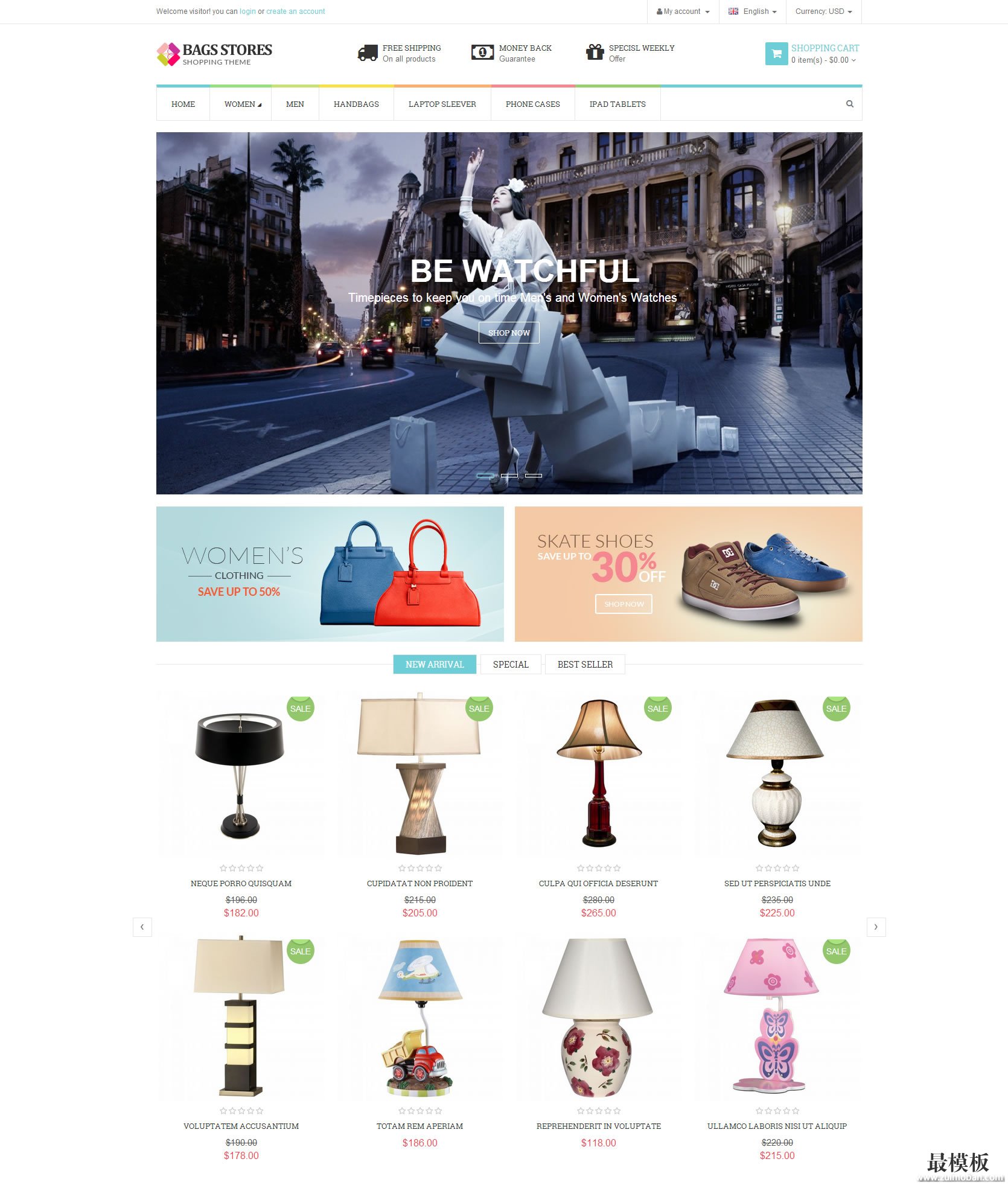

Ves Bags Store外贸综合服饰

人气:219

Ves Bags Store外贸综合服饰

人气:219

-